Storage, der sich selbst heilt — ohne RAID-Rebuild.

Hyperkonvergenter NVMe-Ceph-Storage, dreifach repliziert, angeschlossen mit 40 GBit pro Server in ein 100-GBit-Netzwerk.

Auf dieser Plattform laufen alle unsere Tarife — von Managed Hosting über Server bis zum Managed Cluster. Wenn du wissen willst, was unter deinem Webserver an Storage liegt und warum wir bewusst auf Ceph statt auf klassisches RAID setzen — hier ist die Antwort.

Verteilter Storage statt zentralem RAID.

Ceph ist ein verteiltes Storage-System, das Daten über viele unabhängige Server verteilt — nicht innerhalb eines Servers über mehrere Disks wie klassisches RAID, sondern über das ganze Rechenzentrum hinweg.

Jeder Datenblock wird automatisch auf drei verschiedenen Knoten abgelegt. Fällt eine Disk, ein ganzer Server oder ein Switch aus, sind zwei vollständige Kopien deiner Daten weiter erreichbar — und Ceph stellt die fehlende dritte Replik im Hintergrund auf einem anderen Knoten wieder her, ohne dass irgendjemand eingreifen muss.

Wir setzen Ceph seit 2021 produktiv ein. Vorher haben wir klassische RAID-Setups gefahren — und in der Praxis wieder und wieder erlebt, was passiert, wenn ein RAID-Rebuild stundenlang läuft, während die Anwendung weiter Last erzeugen muss. Das haben wir bewusst hinter uns gelassen.

- OSD — Object Storage Daemon

- Ein Prozess, der eine einzelne NVMe verwaltet. Pro Disk ein OSD. Bei uns läuft typischerweise 12–24 OSDs pro Knoten.

- Replika

- Eine vollständige Kopie eines Datenblocks. Wir fahren immer drei Repliken — Mindestmaß für stabilen Quorum bei Knotenausfällen.

- Self-Healing

- Automatische Wiederherstellung fehlender Repliken auf gesunden Knoten. Läuft ohne menschlichen Eingriff, ohne Service-Unterbrechung.

- Hyperkonvergent

- Storage- und Compute-Workloads auf denselben physischen Servern. Spart eine separate SAN-Infrastruktur ein.

Sechs Prinzipien, an denen wir uns messen lassen.

Wir betreiben Ceph nicht nach Standard-Tutorial. Jeder Cluster bei uns ist auf produktiven Mehr-Mandanten-Betrieb ausgelegt — mit Sizing, Sicherheits-Härtung und Monitoring, die wir uns über die Jahre erarbeitet haben.

Dreifach repliziert

Jeder Datenblock liegt parallel auf drei unabhängigen NVMe-Knoten. Fällt eine SSD aus, bleiben zwei intakte Kopien — kein Datenverlust, kein Wartefenster.

Selbstheilend

Fehlt eine Replik, verteilt der Cluster die fehlenden Blöcke automatisch auf andere Knoten. Kein Admin-Eingriff, kein RAID-Rebuild über Stunden hinweg.

100-GBit-Storage-Netz

Server-Anbindung mit 40 GBit redundant in ein 100-GBit-Backbone. Kein Storage-Network ist je der Engpass — auch nicht bei parallelen Backups oder Replikations-Stürmen.

NVMe von Anfang bis Ende

Kein Hybrid-Setup mit HDD-Cold-Tier. Jede Spindel ist eine Enterprise-NVMe-SSD mit DWPD-Rating und Power-Loss-Protection.

Hyperkonvergent

Storage und Compute laufen auf denselben Knoten — keine separate SAN-Infrastruktur, keine zusätzlichen Latenzen über externe Fabrics.

Open Source, kein Vendor-Lock-in

Ceph ist Open Source unter LGPL-Lizenz, getragen von der Linux Foundation. Keine proprietäre Storage-Appliance, kein Vendor-Erpressungs-Potenzial bei Update-Verträgen.

Wenn eine Disk ausfällt, übernimmt der Cluster.

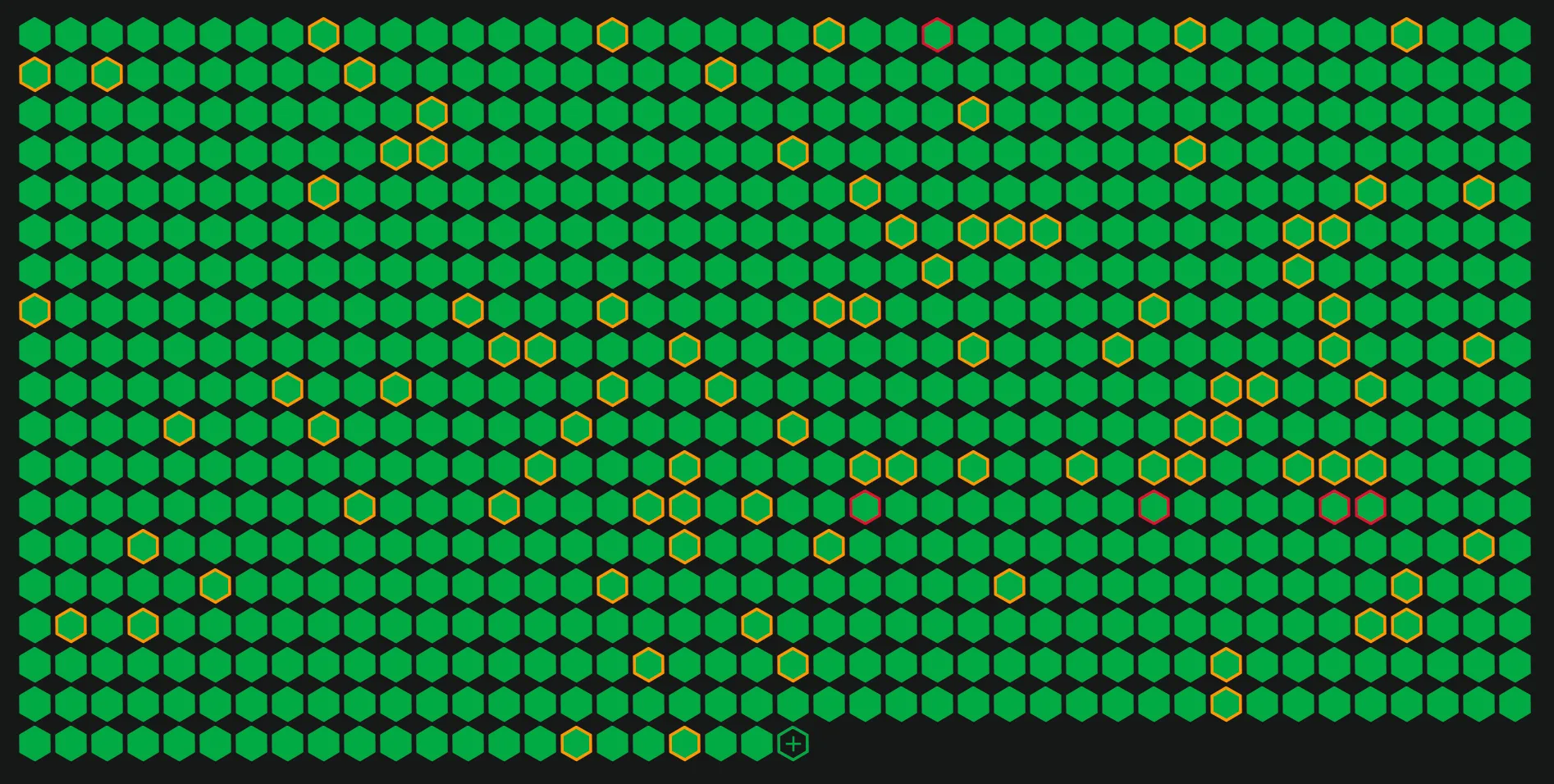

Auf unserem Monitoring-Dashboard ist jeder OSD eine Wabe. Grün heißt gesund, gelb signalisiert Re-Balancing nach Konfigurationsänderung, rot wäre ein echter Defekt. Wir sehen so auf einen Blick, ob alle Knoten und Disks im Soll laufen — und der Cluster sieht es in Echtzeit selbst.

Ausfall erkannt

Heartbeats zwischen den OSDs schlagen aus. Innerhalb weniger

Sekunden markiert der Cluster den ausgefallenen OSD als

down.

Re-Balancing startet

Fehlende Repliken werden gesucht und auf gesunde Knoten kopiert. Die Workload-VMs lesen und schreiben weiter, ohne Unterbrechung — die Last verteilt sich automatisch.

Drei Repliken wiederhergestellt

Cluster-Status zurück auf HEALTH_OK. Wir tauschen die

defekte Disk im Hintergrund aus — kein Wartungsfenster, keine

Service-Unterbrechung für deine Anwendung.

Drei Konsequenzen, die du im Alltag merkst.

Disk-Defekt = kein Vorfall

Wenn eine NVMe ausfällt, merkst du es nicht. Ceph hat den Block schon dreifach woanders, der Cluster verteilt ihn automatisch neu. Wir tauschen die Disk im Hintergrund aus, ohne Wartungsfenster.

Konstante I/O auch bei Wartung

Klassisches RAID 6 fällt während eines Rebuilds in Sekundär-Modus, Performance bricht ein. Bei Ceph läuft die Wiederherstellung verteilt — die Workload-Knoten merken davon kaum etwas.

Wachstum ohne Migrations-Stop

Mehr Speicher? Wir hängen Knoten an den Cluster, der re-balanced sich selbst. Kein Volume-Migrations-Projekt, kein zweites Storage-System parallel zum alten.

Im Klartext: Hardware-Defekte, die in einer klassischen Single-Server-Umgebung Stunden Restore-Aufwand bedeuten würden, bemerkst du auf unserer Plattform nicht. Geprüft, nicht behauptet.

Ceph ersetzt kein Backup — und umgekehrt.

Diese Frage taucht regelmäßig auf, deshalb hier sauber getrennt: Ceph schützt vor Hardware-Defekten, das Backup vor logischen Schäden. Beides braucht es, beides läuft bei uns — als getrennte Schichten, ohne sich zu überschneiden.

Defekt einer Disk, eines Servers, eines Switches.

- NVMe stirbt → 2 Repliken weiter da, Ceph re-balanced.

- Server-Knoten fällt aus → andere Knoten übernehmen, kein Datenverlust.

- Reaktion in Sekunden, automatisch, kein Restore.

Versehen, kompromittierte DB, kaputte Migration.

- Ordner gelöscht → Restore aus Plesk-Backup oder Plattform.

- Ransomware-Verschlüsselung → Plattform-Backup ist append-only.

- Reaktion in Minuten bis Stunden, mit Restore-Pfad.

Hardware-Schaden → Ceph reagiert automatisch, du merkst nichts. Logischer Schaden (versehentlich gelöscht, kompromittiert, falsch deployed) → Backup-Restore über uns oder über die Plesk-Selbstbedienung. Zwei Probleme, zwei unabhängige Mechanismen.

Unsere Server

v4, v5.1, v5.7 — die Hardware-Generationen, die unter dem Ceph-Cluster laufen.

Specs ansehenRechenzentren

Wo unsere Knoten physisch stehen — Nürnberg primär, Düsseldorf für Redundanz.

Standorte ansehenDisaster Recovery & Backup

Die zweite Schicht: Plattform-Backup für logische Schäden, parallel zu Ceph.

Backup-Strategie